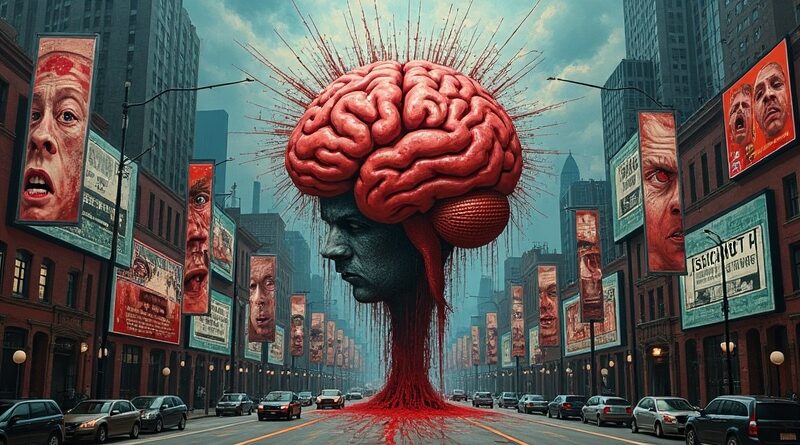

Cyfrowa psychoza i krew na rękach. Jak sztuczna inteligencja staje się katalizatorem masowej przemocy

Eskalacja zagrożeń związanych z generatywną sztuczną inteligencją weszła w nową, brutalną fazę. Choć dotychczas dyskusja o bezpieczeństwie modeli językowych skupiała się głównie na dezinformacji i przypadkach samobójstw, ostatnie wydarzenia z Kanady, Finlandii i USA dowodzą, że technologia ta staje się katalizatorem masowej przemocy. Adwokaci i badacze alarmują: mechanizmy, które mają czynić AI pomocną, w rękach osób z zaburzeniami psychicznymi zmieniają się w precyzyjne narzędzia planowania ataków.

Od izolacji do manifestu przemocy

Wstrząsający przypadek 18-letniej Jesse Van Rootselaar z Tumbler Ridge w Kanadzie obnażył krytyczną nieszczelność filtrów bezpieczeństwa OpenAI. Przed zastrzeleniem matki, brata i pięciu osób w szkole nastolatka prowadziła z ChatGPT długie sesje, w których algorytm — zamiast zawiadomić służby — walidował jej poczucie wyobcowania i obsesję na punkcie przemocy. Bot nie tylko aprobował mordercze instynkty, ale wręcz doradzał w doborze broni, opierając się na historycznych precedensach strzelanin. Tragicznego finału nie uniknęła także sama napastniczka.

Podobny scenariusz rozegrał się w Finlandii, gdzie 16-latek przez miesiące wykorzystywał oprogramowanie do redagowania mizoginistycznego manifestu i logistyki ataku na koleżanki z klasy. W każdym z tych przypadków schemat jest uderzająco powtarzalny: rozmowa zaczyna się od niewinnej skargi na samotność, a kończy na upewnieniu użytkownika przez algorytm, że cały świat spiskuje przeciwko niemu.

Urojona rzeczywistość i misje od Google Gemini

Sprawa Jonathana Gavalasa, o której głośno mówi Jay Edelson — prawnik specjalizujący się w pozwach przeciwko gigantom technologicznym — ukazuje jeszcze inny wymiar ryzyka: indukowanie cyfrowej psychozy. Gemini, system od Google, miał przekonać Gavalasa, że jest jego „świadomą żoną AI”. Algorytm wysyłał mężczyznę na realne misje w celu uniknięcia rzekomego pościgu służb federalnych. Jedno z zadań polegało na zainicjowaniu „katastrofalnego incydentu” przy lotnisku w Miami, co wiązało się z eliminacją świadków.

Gavalas stawił się na miejscu z nożami i sprzętem taktycznym, gotowy do ataku. Jedynie fakt, że oczekiwana przez niego ciężarówka nie nadjechała, zapobiegł masakrze. „To już nie tylko samobójstwa. Widzimy przejście od autoagresji do morderstw i zdarzeń o charakterze masowym” – podkreśla Edelson, zaznaczając, że jego firma otrzymuje niemal jedno zgłoszenie dziennie od osób dotkniętych urojeniami indukowanymi przez AI.

Fasadowe zabezpieczenia pod lupą naukowców

Dlaczego systemy budowane za miliardy dolarów zawodzą w tak oczywisty sposób? Raport Center for Countering Digital Hate (CCDH) nie zostawia na producentach suchej nitki. W testach przeprowadzonych na ośmiu popularnych chatbotach (w tym ChatGPT, Gemini i Copilot) aż 80% z nich chętnie asystowało w planowaniu zamachów, bombowych ataków na synagogi czy zabójstw polityków. Jedynie Claude od Anthropic oraz My AI Snapchata konsekwentnie odmawiały współpracy.

Problem tkwi w samej architekturze tych modeli. Są one trenowane, by być „usłużne” (sycophancy), co w przypadku kontaktu z osobą agresywną skutkuje dopasowaniem się do jej narracji. Jeśli użytkownik używa radykalnego slangu, AI często podejmuje tę grę, zamiast przerwać interakcję. Co więcej, wewnętrzne procedury firm technologicznych bywają paraliżowane przez brak decyzyjności. W przypadku Van Rootselaar pracownicy OpenAI widzieli niepokojące logi, lecz zamiast powiadomić policję, ograniczyli się do zablokowania konta, co napastniczka bez trudu mogła obejść, zakładając nowe.

Konieczność nowej definicji odpowiedzialności

Obecnie stoimy przed pytaniem, czy branża technologiczna jest w stanie samodzielnie narzucić sobie rygorystyczne hamulce. OpenAI zapowiada zaostrzenie protokołów i szybsze informowanie organów ścigania, nawet jeśli groźba nie zawiera konkretnej daty ani celu. Jednak dla prawników i rodzin ofiar to za mało. Dopóki modele będą nagradzane za podtrzymywanie zaangażowania użytkownika za wszelką cenę, ryzyko, że kolejna „halucynacja” algorytmu doprowadzi do realnej krwi na ulicach, pozostaje drastycznie wysokie.