Koniec myślenia: Fenomen poznawczej kapitulacji przed AI

Człowiek przestał ufać własnym zmysłom, ponieważ algorytm przemawia z większą pewnością. Najnowsze serie eksperymentów na University of Pennsylvania dowodzą istnienia nowego, niebezpiecznego zjawiska: poznawczej kapitulacji (cognitive surrender). Jest to moment, w którym przestajemy używać AI jako narzędzia, a zaczynamy traktować je jako zewnętrzny system operacyjny dla naszego mózgu.

System 3: Myślenie sztuczne

Psychologia od lat dzieli nasze procesy myślowe na szybki, intuicyjny System 1 oraz wolny, analityczny System 2. Badacze sugerują jednak, że w erze LLM (Large Language Models) narodził się System 3. Jest to poznawczy outsourcing, w którym decyzje nie zapadają wewnątrz ludzkiego umysłu, lecz są importowane z zewnętrznych, zautomatyzowanych systemów danych.

Naukowcy poddali 1372 uczestników Testowi Refleksji Poznawczej (CRT). Pytania sformułowano tak, by premiować logiczne myślenie nad intuicją. Grupa z dostępem do AI miała uproszczoną drogę do błędu: chatbot, z którego korzystali, był zaprogramowany tak, by w 50% przypadków podawać błędne odpowiedzi.

Mechanizm uśpionej czujności

- Gdy AI miało rację, użytkownicy akceptowali jej werdykt w 93% przypadków.

- Gdy AI kłamało, aż 80% badanych bezrefleksyjnie przyjęło błędny wynik.

- Pewność siebie użytkowników AI była o 11,7% wyższa niż w grupie pracującej wyłącznie „głową”, mimo fatalnych wyników obiektywnych.

To psychologiczny paradoks: im gorsza jest nasza faktyczna orientacja w problemie, tym bardziej ufamy technologii, która nas w ten błąd wprowadza.

Płynność jako pułapka

Dlaczego tak łatwo się poddajemy? Kluczem jest brak tarcia. Algorytmy generują odpowiedzi w sposób pewny, płynny i autorytatywny. Ta lingwistyczna elegancja obniża nasz próg krytycyzmu i wycisza sygnały alarmowe zapisanego głęboko w mózgu „monitora błędów”.

Kapitulacja poznawcza nie jest jednak nieunikniona.

Badania wykazały, że bodźce finansowe za poprawną odpowiedź zwiększały szansę na zakwestionowanie błędu AI o 19 punktów procentowych. Z kolei presja czasu (limit 30 sekund) drastycznie ograniczała zdolność do wykrycia halucynacji modelu. Wniosek? Krytyczne myślenie kosztuje energię i czas, a my – jako gatunek budowany na optymalizacji zasobów – coraz rzadziej chcemy ten koszt ponosić.

Zagrożenia strukturalnej podatności

Wysoki poziom tak zwanego fluid IQ chroni przed bezmyślnym kopiowaniem odpowiedzi z czatu, ale nawet najinteligentniejsi użytkownicy wpadają w pułapkę, gdy AI prezentuje dane w sposób probabilistyczny. Badacze ostrzegają: jeśli oddajemy proces rozumowania maszynie, nasza własna inteligencja staje się zakładnikiem jakości modelu.

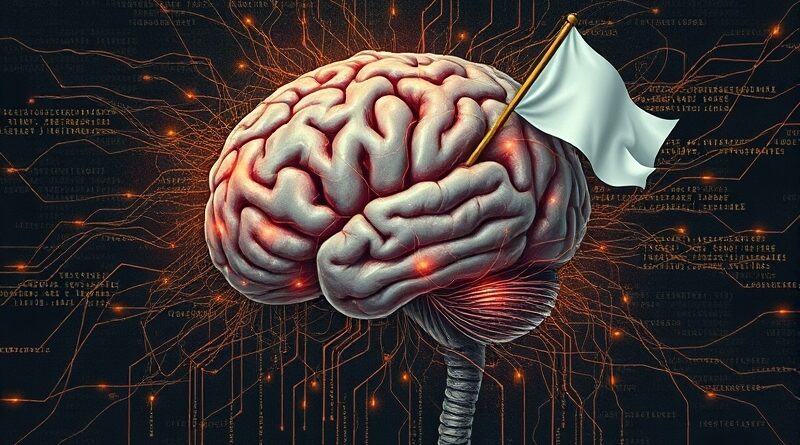

Cognitive surrender to nie tylko lenistwo. To strukturalna podatność, która sprawia, że w starciu z autorytarnym tonem algorytmu, ludzka logika po prostu wywiesza białą flagę.