Koniec prawdy w obrazowaniu medycznym? Radiolodzy bezradni wobec deepfake’ów

Radiolodzy z kilkudziesięcioletnim stażem właśnie stracili monopol na ocenę autentyczności tego, co widzą na ekranach. Badanie przeprowadzone przez Icahn School of Medicine at Mount Sinai w Nowym Jorku bije na alarm: medyczne deepfake’i stały się tak doskonałe, że lekarze nie potrafią ich odróżnić od rzeczywistych złamań czy zmian nowotworowych.

Kliniczna doskonałość to nowa flaga ostrzegawcza

Paradoksalnie, to właśnie perfekcja obrazu powinna budzić niepokój. Sztuczna inteligencja, tworząc syntetyczne obrazy, ma tendencję do generowania struktur, które wyglądają „lepiej niż w naturze”.

Czego nie wyłapuje oko lekarza?

- Nadmierna gładkość kości i nienaturalnie proste kręgosłupy.

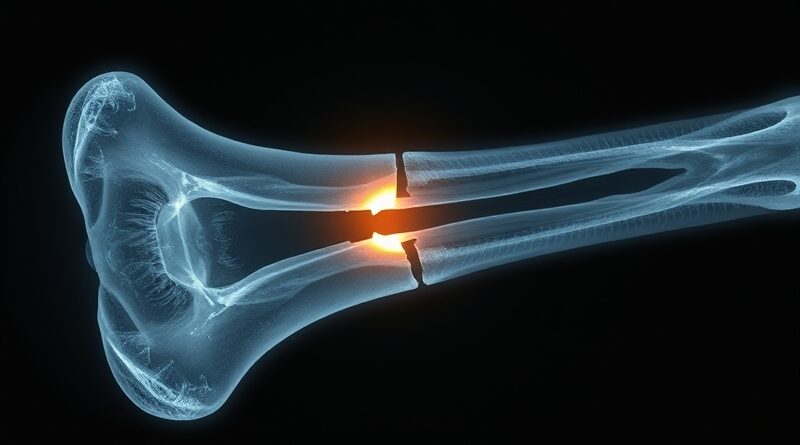

- Zbyt sterylne złamania, które pojawiają się tylko po jednej stronie kości bez towarzyszącej opuchlizny tkanek miękkich.

- Lustrzana symetria płuc i podejrzanie uporządkowane wzorce naczyń krwionośnych.

Problem w tym, że w warunkach codziennej pracy nikt nie szuka dowodów na fałszerstwo.

Kiedy lekarze nie wiedzieli, że test zawiera fałszywki, ich skuteczność w ich identyfikacji wynosiła dramatyczne 41%. To wynik gorszy niż rzut monetą.

Sztuczna inteligencja oszukuje własnych twórców

Naukowcy postawili naprzeciw siebie gigantów. Testom poddano 17 radiologów z całego świata oraz najpotężniejsze modele multimodalne: GPT-4o, Gemini 2.5 Pro oraz Llama 4 Maverick. Wyniki? Żaden z nich nie jest odporny na manipulację.

Nawet GPT-4o, czyli model użyty do wygenerowania części fałszywych obrazów, miewał problemy z rozpoznaniem własnych dzieł. To brutalny dowód na to, że pętla sprzężenia zwrotnego w generatywnej sztucznej inteligencji staje się coraz szczelniejsza.

Doświadczenie nie jest już tarczą

Badanie wykazało szokujący brak korelacji między stażem pracy a umiejętnością detekcji deepfake’ów. Radiolog z 40-letnim doświadczeniem był równie podatny na manipulację co rezydent. Wyjątek stanowili jedynie specjaliści od układu mięśniowo-szkieletowego, którzy wypadali statystycznie lepiej, ale wciąż daleko im było do stuprocentowej pewności.

Sabotaż w systemie opieki zdrowotnej

To nie jest tylko akademicka ciekawostka. To egzystencjalne zagrożenie dla cyberbezpieczeństwa szpitali.

Wyobraźmy sobie hakera, który wstrzykuje syntetyczne obrazy do systemu PACS (Picture Archiving and Communication System). Fałszywe złamanie może wymusić niepotrzebną operację, a cyfrowe „wyczyszczenie” guza może doprowadzić do śmierci pacjenta z powodu zaniechania leczenia. Do tego dochodzą gigantyczne wyłudzenia odszkodowań za nieistniejące urazy.

Metadane to za mało

W obliczu kryzysu zaufania autorzy badania sugerują radykalne zmiany w cyfrowym obiegu dokumentacji medycznej. Rozwiązaniem nie jest edukacja personelu, która ma swoje limity, lecz twarda kryptografia.

Standardem muszą stać się niepodrabialne, niewidoczne znaki wodne oraz podpisy kryptograficzne generowane przez aparat rentgenowski w momencie wykonania zdjęcia. Bez tego każda próba diagnozy na odległość stanie się rosyjską ruletką.

To dopiero wierzchołek góry lodowej. Następnym krokiem sztucznej inteligencji będzie generowanie syntetycznych obrazów 3D – tomografii komputerowej i rezonansu magnetycznego. Jeśli nie zbudujemy systemów weryfikacji teraz, fundament medycyny opartej na dowodach wizualnych po prostu się rozsypie.