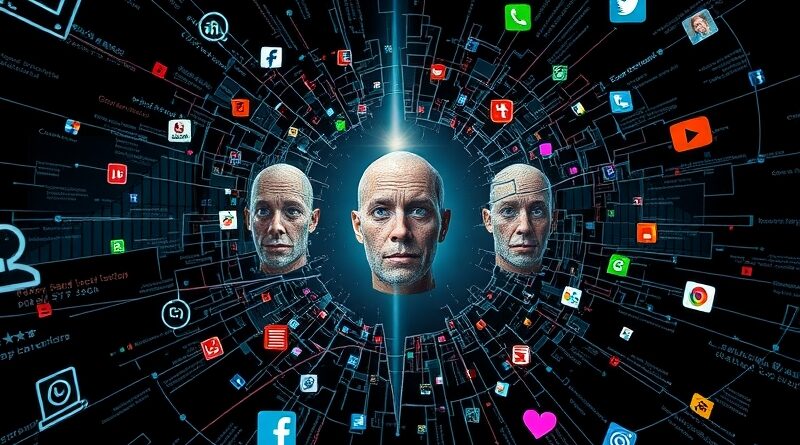

Sztuczna inteligencja w walce z dezinformacją w mediach społecznościowych?

W dzisiejszych czasach, kiedy coraz więcej osób czerpie informacje z mediów społecznościowych, łatwo wpaść w pułapkę clickbaitów i dezinformacji. Algorytmy, analizując nasze preferencje, serwują nam treści podobne do tych, które już polubiliśmy, tworząc tak zwaną „echo chamber” – bańkę informacyjną, w której utwierdzamy się w swoich przekonaniach, nawet jeśli mijają się one z prawdą.

Naukowcy z Binghamton University w stanie Nowy Jork podjęli próbę rozwiązania tego problemu. Zaproponowali oni stworzenie systemu opartego na sztucznej inteligencji, który analizowałby interakcje między treściami a algorytmami platform cyfrowych. Celem jest identyfikacja źródeł potencjalnej dezinformacji i umożliwienie użytkownikom oraz administratorom platform, takich jak Meta czy X (dawniej Twitter), podejmowanie odpowiednich działań, np. usuwanie szkodliwych treści.

Jak działa echo chamber?

Thi Tran, profesor systemów zarządzania informacją z Binghamton University School of Management, zwraca uwagę na to, jak szybko rozpowszechniają się informacje w mediach społecznościowych. „Środowisko online stwarza idealne warunki do powstawania efektu echo chamber” – podkreśla Tran. Dodaje, że kluczowe jest kwestionowanie wiarygodności informacji, niezależnie od tego, czy zostały one wygenerowane przez ludzi, czy przez AI.

Platformy cyfrowe, optymalizując dostarczanie treści na podstawie zaangażowania użytkowników i wzorców zachowań, dodatkowo wzmacniają dynamikę echo chamber. Interakcje z osobami o podobnych poglądach prowadzą do selektywnego wybierania informacji, co w efekcie ogranicza dostęp do różnorodnych perspektyw.

Badanie na studentach

W ramach badania przeprowadzono ankietę wśród 50 studentów, którzy oceniali prawdziwość pięciu fałszywych twierdzeń na temat szczepionek przeciwko COVID-19. Wyniki pokazały, że:

- 90% studentów zadeklarowało, że mimo usłyszenia fake newsów i tak zaszczepiłoby się przeciw COVID-19.

- 70% udostępniłoby te informacje w mediach społecznościowych, częściej rodzinie i znajomym niż obcym.

- 60% rozpoznało, że twierdzenia są nieprawdziwe.

- 70% wyraziło potrzebę przeprowadzenia dodatkowego researchu, aby zweryfikować te informacje.

Odpowiedzi te pokazały, że wiele osób jest w stanie rozpoznać fałszywe informacje, ale jednocześnie odczuwa potrzebę poszukiwania dowodów na ich obalenie.

AI kontra dezinformacja

Naukowcy są przekonani, że zamiast polegać wyłącznie na fact-checkerach, można wykorzystać tę samą generatywną sztuczną inteligencję, która jest używana do rozpowszechniania dezinformacji, do promowania wiarygodnych treści. „Chcemy przejrzystości informacji, ale im bardziej jesteśmy wystawieni na określone informacje, tym bardziej wierzymy, że są one prawdziwe, nawet jeśli są niedokładne” – tłumaczy Tran.

Artykuł naukowy „Echoes Amplified: A Study of AI-Generated Content and Digital Echo Chambers” został zaprezentowany na konferencji zorganizowanej przez Society of Photo-Optical Instrumentation Engineers (SPIE). Autorami publikacji są również Seden Akcinaroglu, Nihal Poredi i Ashley Kearney.