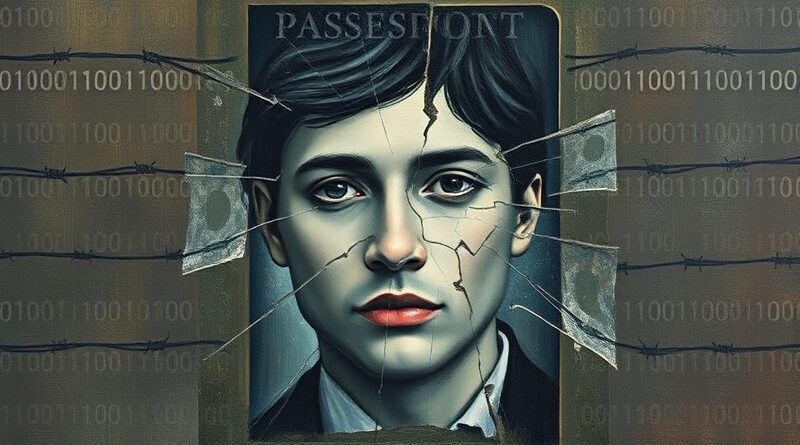

Prywatność miała twarz Claude’a. Teraz Anthropic żąda twojego paszportu

Anthropic właśnie własnoręcznie zdetonowało swój najsilniejszy atut wizerunkowy. Firma, która zbudowała potęgę na fundamencie „bezpieczeństwa i etyki”, po cichu wdrożyła wymóg przesyłania skanów paszportów oraz zdjęć selfie od wybranych użytkowników.

Koniec miodowego miesiąca z prywatnością

To nie jest zwykła aktualizacja regulaminu. To czołowe zderzenie z rzeczywistością dla milionów ludzi, którzy zaledwie kilka tygodni temu porzucili ChatGPT na rzecz Claude’a. Powód był prosty: OpenAI podpisało kontrakt z Pentagonem, otwierając drogę do inwigilacji na masową skalę. Anthropic miało być „tymi dobrymi”, którzy odmówili współpracy z wojskiem.

Dzisiaj ta narracja pęka.

AI z paszportem w ręku

Weryfikacja tożsamości (KYC) w świecie chatbotów AI dotychczas praktycznie nie istniała. Anthropic zmienia zasady gry, stawiając na infrastrukturę firmy Persona – tego samego dostawcy, który obsługuje sektor bankowy. Jeśli algorytm uzna twoją aktywność za podejrzaną, nie wystarczy już adres e-mail. Będziesz potrzebować:

- fizycznego, nieuszkodzonego paszportu lub dowodu osobistego;

- zdjęcia selfie wykonanego w czasie rzeczywistym;

- cierpliwości, podczas gdy zewnętrzny podmiot przetwarza twoje najbardziej wrażliwe dane.

Bezpieczeństwo czy kontrola?

Oficjalna wersja? Anthropic twierdzi, że to środek zapobiegawczy przeciwko nadużyciom i „rutynowa kontrola integralności platformy”. Rzecznik firmy uspokaja, że dane trafiają do serwerów Persona, nie służą do trenowania modeli i są szyfrowane.

Problem w tym, że żadna trzecia strona nie jest niezniszczalna.

Wystarczy przypomnieć wyciek z Discorda w 2025 roku, gdzie hakerzy przejęli 70 000 dokumentów tożsamości przesłanych do weryfikacji wieku. Kiedy oddajesz biometrię i dokument rządowy firmie technologicznej, robisz to na własne ryzyko. Anthropic de facto tworzy precedens: dostęp do zaawansowanej inteligencji wymaga teraz pełnej transparentności obywatelskiej.

Geopolityczny mur

Nowa polityka uderza najmocniej w użytkowników z regionów, których Anthropic oficjalnie nie obsługuje. Chińscy deweloperzy korzystający z Claude’a przez systemy pośredniczące zostali praktycznie odcięci. Biometria jest nie do przeskoczenia dla tych, którzy operują w szarej strefie dostępu do AI.

Czy to początek ery racjonowania technologii? Możliwe. Anthropic nie czekało na regulacje rządowe. Wprowadzili autorski system nadzoru, bo mogli.

Wygląda na to, że era anonimowego eksperymentowania z AI właśnie dobiegła końca. Claude, który miał być twoim dyskretnym asystentem, właśnie stał się cyfrowym celnikiem.